Mit AR die Google-Suche und Google Lens visuell erleben

Neue Informationen lassen sich am besten veranschaulichen, indem man sie – wie es das Wort schon sagt – direkt sichtbar macht. Wir haben heute auf der I/O neue Funktionen für die Google-Suche und Google Lens vorgestellt. Mithilfe der Kamera, maschinellen Sehens und Augmented Reality (AR) können auf diese Weise bestimmte Inhalte in der realen Umgebung abgebildet werden – und so euren Alltag weiter erleichtern.

AR in der Google-Suche

Ein fliegender Weißer Hai? Google Lens macht’s möglich.

In den nächsten Wochen werden wir eine neue Funktion in der Google-Suche veröffentlichen, mit der Nutzer 3D-Objekte direkt aus der Suche in ihrem Umfeld platzieren können. So ist es nicht nur möglich, gewisse Dinge genauer zu betrachten – ihr bekommt außerdem ein besseres Gefühl für die eigentliche Form und Größe. Es ist zum Beispiel eine Sache, zu lesen, dass ein Weißer Hai bis zu fünfeinhalb Meter lang werden kann. Einen wirklichen Eindruck davon erhaltet ihr aber erst, wenn ihr ihn dann in seiner tatsächlichen Größe vor euch seht. Wenn ihr künftig in der Suche nach bestimmten Tieren sucht, könnt ihr einige direkt im Knowledge Panel in 3D und AR ansehen.

Animiertes 3D-Modell von als Suchergebnis für „Muskelanspannung“

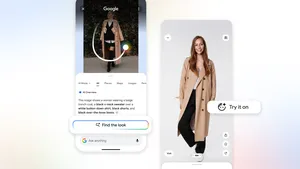

Wir arbeiten außerdem mit Partnern zusammen, um auch ihre Inhalte künftig in 3D in der Google-Suche darstellen zu können. So erweckt ihr bald viele weitere dreidimensionale Objekte direkt aus der Suche vor euren eigenen Augen zum Leben – ganz egal, ob es sich dabei um anatomische Modelle des menschlichen Körpers oder um ein neues Paar Sneaker handelt.

Neue Funktionen für Google Lens

Über eine Milliarde mal haben Menschen Google Lens schon genutzt, um mehr über die Dinge in ihrer Umgebung zu erfahren. Für eine möglichst präzise Antwort greift Google Lens dabei auf maschinelles Lernen (ML), maschinelles Sehen und Milliarden von Fakten im Knowledge Graph zurück. Ab sofort arbeiten wir daran, noch visuellere Antworten auf diese visuellen Fragen zu finden.

Stellen wir uns einmal vor, ihr seid in einem Restaurant und könnt euch nicht entscheiden. Google Lens hebt die besonders beliebten Gerichte auf der Speisekarte automatisch hervor. Wenn ihr dann auf ein Gericht tippt, könnt ihr anhand von Fotos und Rezensionen auf Google Maps sofort sehen, wie es tatsächlich aussieht – und wie es den anderen Gästen bisher geschmeckt hat.

Was soll ich bloß essen? Google Lens hilft bei der Entscheidung.

Doch wie funktioniert das genau? Als Erstes erkennt Google Lens die ganzen Gerichte auf der Karte und unterscheidet anhand der Schriftgröße, Schriftart und Farbe diese von der Beschreibung. Dann werden die Namen der Gerichte mit den dazugehörigen Fotos aus der Restaurantbewertung in Google Maps abgeglichen.

Google Lens ist vor allem dann besonders hilfreich, wenn ihr im Urlaub seid und die Landessprache nicht versteht. In diesem Fall könnt ihr ganz einfach die Kamera auf den zu übersetzenden Text halten. Google Lens zeigt dann die Übersetzung direkt über dem Ausgangstext an – und das in mehr als 100 Sprachen!

Google Lens übersetzt den Text und zeigt ihn direkt über dem Original an

Doch wir arbeiten an noch mehr Möglichkeiten, um hilfreiche digitale Informationen mit der realen Welt zu verknüpfen. Im De Young Museum in San Francisco erhaltet ihr mithilfe von Google Lens beispielsweise versteckte Hintergrundgeschichten von den Kuratoren zu den Bildern. Oder wenn ihr ein Rezept aus einer Kochzeitschrift nachkochen möchtet, richtet einfach eure Kamera auf das Rezept und schon könnt ihr loslegen.

Mit Google Lens erwachen Rezepte zum Leben

Lens für Google Go

Weltweit haben über 800 Millionen Erwachsene Schwierigkeiten, alltägliche Dokumente wie Busfahrpläne oder Bankformulare zu lesen. Mit Google Lens werden jetzt diese und andere Texte ganz einfach vom Smartphone vorgelesen.

Dazu müsst ihr eure Kamera nur auf den jeweiligen Text richten. Die einzelnen Wörter werden dabei hervorgehoben, sodass ihr den Text mitverfolgen und in seinem gesamten Zusammenhang verstehen könnt. Außerdem könnt ihr auch einzelne Wörter antippen, um nach ihrer Bedeutung zu suchen. Diese Funktion ist zunächst für Google Go verfügbar – die Such-App für Smartphone-Neulinge. Die Lens-Funktion für Google Go ist nur 100 KB groß und funktioniert sogar auf Smartphones, die 50 Euro kosten.

All diese neuen Funktionen in der Google-Suche und in Google Lens machen es möglich, die Welt um uns herum visuell zu erkunden und uns so den Alltag zu erleichtern. So bekommt ihr Informationen auf die intuitivste Art und Weise: Ihr erfahrt sie mit euren eigenen Augen.