Haciendo que la Inteligencia Artificial funcione para todos

Son ya 13 años que llevo trabajando en Google y me resulta sorprendente cómo la misión de la compañía de “hacer que la información sea universalmente accesible y útil” siga siendo tan relevante hoy como cuando empecé a trabajar aquí. Desde el principio, nuestra intención ha sido resolver problemas complejos utilizando las ciencias de la computación, aún cuando la tecnología que nos rodea nos fuerce a hacer cambios dramáticos.

Los problemas más complejos tienden a ser aquellos que afectan la vida cotidiana de las personas, y es alentador ver cómo muchas personas utilizan Google a diario: recientemente hemos superado los 2 mil millones de dispositivos Android activos mensualmente; YouTube no sólo tiene mil millones de usuarios pero también mil millones de horas vistas al día; y las personas utilizan Google Maps para navegar por más de mil millones de kilómetros cada día. Este crecimiento hubiera sido impensado sin haber cambiado de paradigma —del ordenador al móvil— que nos ha obligado a repensar todos nuestros productos y reiventarlos para reflejar nuevos modelos de interacción como son las pantallas multitáctiles.

Hoy estamos siendo testigos de un nuevo cambio de paradigma: la transición de un mundo ‘mobile-first’ hacia uno ‘AI-first’. Y como en el pasado, está forzándonos a reimaginar nuestros productos para un mundo que permita interacciones más naturales con la tecnología. Piensa en las búsquedas: el algoritmo fue construido sobre la base de nuestra habilidad de entender textos en páginas web. Pero ahora, gracias a los avances en aprendizaje profundo, somos capaces de hacer que imágenes, fotos y vídeos sean útiles para las personas de una manera nunca antes vista. Por ejemplo, tu cámara puede “ver” o puedes hablar a tu teléfono y éste te responderá —el habla y la visión se están convirtiendo en un componente tan importante de la computación como el teclado o las pantallas multitáctiles.

El Asistente es un poderoso ejemplo de estos adelantos en funcionamiento. Está ya disponible en 100 millones de dispositivos, y volviéndose más útil cada día. Ahora podemos distinguir diferentes voces en Google Home, proporcionando a las personas una experiencia más personalizada cuando interactúan con el dispositivo. Google Lens es una serie de capacidades computacionales basadas en la visión que pueden entender qué estás observando y ayudarte a ejecutar acciones basadas en esa información. Si te has agachado debajo de la mesa de un amigo para ver la contraseña de Wi-Fi en la parte trasera del router, tu móvil ahora puede reconocer la contraseña, entender que estás tratando de conectarte a una red Wi-Fi y automáticamente conectarte. La clave aquí es que no necesitas aprender nada nuevo para hacer que todo esto funcione — la interfaz y la experiencia puede ser mucho más intuitiva que, por ejemplo, copiar y pegar entre aplicaciones en tu smartphone. En un primer paso estaremos trayendo las capacidades de Google Lens al Asistente y Google Photos y puedes esperar verlo en otros productos también.

Con Google Lens la cámara de tu teléfono inteligente no sólo verá lo que ves, sino que también comprenderá lo que estás viendo y te ayudará a ejecutar acciones

Todo esto requiere una correcta arquitectura computacional. El año pasado en I/O, anunciamos la primera generación de nuestros TPUs, que nos permiten ejecutar nuestros algoritmos de aprendizaje automático de manera más rápida y eficiente. Hoy anunciamos nuestra próxima generación de TPUs — Cloud TPUs, que están optimizados para inferencia y entrenamiento y pueden procesar MUCHA información. Estaremos trayendo estos Cloud TPUs a Google Compute Engine de forma que empresas y desarrolladores puedan aprovecharlos.

Cloud TPUs son procesadores diseñados y fabricados a medida para aplicaciones de machine learning. 64 de estos dispositivos pueden ser insertados en una misma configuración llamada TPU pod, resultando en una supercomputadora de 11.5 petaflops

Es importante para nosotros hacer que estos avances funcionen mejor para todos —no sólo para los usuarios de los productos Google. Creemos que los grandes avances en problemas sociales complejos serán posibles si científicos e ingenieros pueden tener mejores y más poderosas herramientas computacionales e investigación al alcance de la mano. Pero hoy existen muchas barreras para que esto suceda.

Esta es la motivación detrás de Google.ai, que reúne todos nuestras iniciativas en IA en una sola para reducir estas barreras y acelerar la forma en que investigadores, desarrolladores y empresas trabajan en este campo.

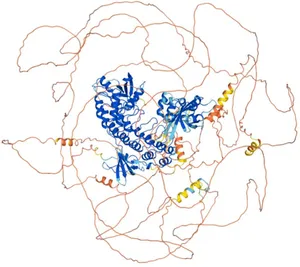

Una de las formas en las que esperamos hacer la inteligencia artificial más accesible es simplificando la creación de modelos de aprendizaje automático llamados redes neuronales. Hoy en día, diseñar una red neuronal consume mucho tiempo y requiere de un expertise que limita su uso a una comunidad pequeña de científicos e ingenieros. Por esta razón hemos creado un enfoque llamado AutoML, que demuestra que es posible diseñar redes neuronales que diseñan redes neuronales. Esperamos que AutoML asuma una habilidad que pocos PhDs tienen hoy y que haga posible que de 3 a 5 años incluso cientos de miles de desarrolladores diseñen redes neuronales nuevas para sus necesidades particulares.

Adicionalmente, Google.ai se ha asociado con investigadores de Google, científicos y desarrolladores para atacar problemas a lo largo de un rango de disciplinas con resultados prometedores. Hemos usado aprendizaje automatizado para mejorar el algoritmo que detecta la propagación del cáncer de mama a los ganglios linfáticos adyacentes. También hemos visto que la inteligencia artificial está produciendo grandes avances en tiempo y precisión en el trabajo de investigadores para predecir las propiedades de las moléculas e incluso la secuencia del genoma humano.

La inteligencia artificial puede contribuir a las ciencias básicas, como la secuenciación del ADN. Una nueva herramienta de Google.ai ayuda a los investigadores a identificar variantes genéticas más rápido

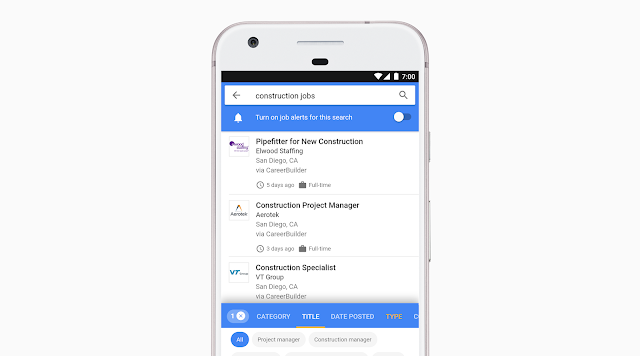

Este cambio no se trata únicamente de construir dispositivos futuristas o realizar investigaciones innovadoras. Por ejemplo, casi la mitad de los empleadores en Estados Unidos dicen que todavía tienen problemas en encontrar candidatos para posiciones abiertas. Mientras tanto, los solicitantes de empleo a menudo no saben que hay una posición abierta próxima a ellos, porque la naturaleza de las publicaciones de puestos —con alta rotación, bajo tráfico e inconsistencia en los títulos— ha hecho que los motores de búsqueda lo encuentren difícil de clasificar. A través de una nueva iniciativa, Google for Jobs, esperamos conectar empresas con potenciales empleados y ayudar a solicitantes de empleo a encontrar nuevas oportunidades. Como parte de esta iniciativa, estaremos lanzando una nueva funcionalidad en Search en las próximas semanas, que ayuda a la gente a encontrar empleo entre una amplia gama de campos y niveles salariales, incluyendo aquellos puestos de trabajo que tradicionalmente han sido difíciles de buscar y clasificar, como retail y servicios.

Hemos creado una nueva funcionalidad para que no importa quién seas o qué tipo de trabajo estés buscando, puedas encontrar las ofertas de trabajo que son adecuados para ti

Es inspirador ver cómo la inteligencia artificial está comenzando a cosechar frutos que la gente ya puede empezar a probar. Todavía hay un largo camino que recorrer antes de pasar a un mundo verdaderamente “AI-first”, pero cuanto más podamos hacer para democratizar el acceso a la tecnología —tanto en términos de herramientas que las personas usar como en formas de aplicarla— más pronto todo el mundo se podrá beneficiar de ello.

Lee más sobre todos los anuncios de Google I/O, incluyendo Android, Photos y Realidad Virtual — en este sitio.