Google と AI : 私たちの基本理念

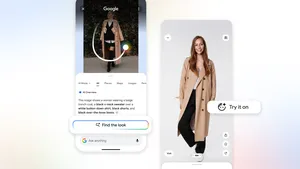

AI の本質とは、学習し適応するコンピュータ プログラムです。AI はすべての問題を解決することはできませんが、一方で、私たちの生活を向上させる計り知れない可能性を持っています。Google は、スパムに悩まされず 簡単に文面を作成できる メールや、 自然な言葉で話しかける ことができるデジタル アシスタント、楽しい写真を ポップアップ表示 するフォトアルバムなど、 AI を使って製品をより便利にしています。

Google が提供する製品以外でも、Google は喫緊の課題に挑戦するために AI を活用しています。2 人の高校生は AI 搭載のセンサーによって 森林火災リスクの予測 に取り組んでいます。酪農家は 牛の群れの健康状態をモニターする ために AI を活用しています。医療現場でも、 ガンの診断支援や失明予防など で、医師による AI 活用が始まっています。このような明確な利点こそが、Google が AI の研究開発に大きく投資し、AI の技術をツールやオープンソース コードとして広く公開する理由です。

一方で、私たちは、このような強力な技術が、同じだけの強さで、その利用について問題提起することも認識しています。AI がどのように開発され使われるかは、今後長期に渡り社会に大きな影響を与えるでしょう。AI のリーダーとして Google はこの問題に正しく向き合うべく、強い責任を感じています。そこで、 Google では、今後の指針となる 7 項目の基本理念を発表しました。これらの理念は決して理論的な概念ではなく、積極的に Google の研究や製品開発を左右し、事業判断に影響を及ぼす具体的な基準です。

AI を取り巻く分野はダイナミックに発展を続けています。その点を踏まえ、Google は謙虚な姿勢で事業に取り組むとともに、社内外とコミュニケーションを重ね、今後の学びに応じて、私たち自身の取組みを柔軟に適応させていきます。

AI 利用における基本方針

Google は以下のような基本方針を元に AI の利用を決定します。

1. 社会にとって有益である

新しいテクノロジーの普及は、ますます社会全体に影響を与えるようになっています。AI の進歩は、医療、セキュリティ、エネルギー、交通、製造、エンターテイメントなど、幅広い分野に大きな変化をもたらすでしょう。AI 技術の開発・利用の可能性を検討するにあたっては、幅広い社会的・経済的要因を考慮し、期待できる全体的な利点が、予測可能なリスクやマイナスをはるかに上回ると判断した場合に、開発・利用を進めます。

AI は、コンテンツを理解するという処理を大規模に行う能力を強化します。Google は製品を提供する各国の文化的、社会的、法的規範を引き続き尊重しながら、AI を活用して高品質かつ正確な情報を人々が容易に入手できるよう努めます。そして、Google のテクノロジーをどのような場合に、非営利目的で提供するかについて、引き続き慎重に検討します。

2. 不公平なバイアスの発生、助長を防ぐ

AI のアルゴリズムやデータセットは、不公平なバイアスを反映したり、強化したり、反対にそれらを緩和することもできます。あるバイアスが公平か、不公平かを判断することは必ずしも容易ではなく、文化や社会的背景によってその判断が分かれます。しかしながら、特に人種、民族、性別、国籍、所得、性的指向、能力、政治的または宗教的信念などといった繊細なトピックにおいて AI が不当な影響を与えることがないよう努めます。

3. 安全性確保を念頭においた開発と試験

害を及ぼす可能性のある予期せぬ事象の発生を避けるために、Google は継続的に強固な安全性とセキュリティ対策の実践、強化に努めます。Google は自社の AI システムに適切な慎重性を組み込み、AI セーフティ研究のベストプラクティスに沿って開発を行うことを目指します。しかるべき場合には、AI 技術をコントロールされた環境下でテストし、運用開始後も動作のモニタリングを行います。

4. 人々への説明責任

Google は、フィードバックをしたり、関連する説明を求めたり、異議を唱える機会を提供できるようにAI システムを設計します。Googleの AI 技術は、人間による適切な指示、およびコントロール下に置かれます。

5. プライバシー・デザイン原則の適用

Google は、AI 技術の開発および利用に Google のプライバシー原則を適用します。プライバシーに関する通知および同意の機会を提供し、プライバシー保護が組込まれたアーキテクチャを推奨すると共に、データ利用に適切な透明性およびコントロールを提供します。

6. 科学的卓越性の探求

技術革新は、科学的な手法と、オープンな考察、学問的厳密性、整合性、およびコラボレーションへのコミットメントに根ざしています。AI ツールは、科学の新たな領域を切り拓き、生物学、化学、医学、環境科学などといった分野において、新たな知識を生み出す可能性を秘めています。Google は AI 開発を進めるにあたり、高水準の科学的卓越性を目指します。

また、科学的に厳密で、学際的なアプローチを用い、多様なステークホルダーと協力して、この分野における思慮深いリーダーシップの促進に努めます。加えて、より多くの人々が有用な AI の利用方法を開発できるよう、Google は教育用コンテンツやベストプラクティス、リサーチを通じ、責任ある形で AI の知識や知見を共有します。

7. これらの基本理念に沿った利用への技術提供

多くのテクノロジーには、様々な利用方法があります。Google は、有害もしくは悪質な可能性のある利用を制限するよう努めます。AI 技術の開発や提供にあたって、Google は想定される用途を以下の要件に沿って検証します。

- 主な目的と用途: テクノロジーやその利用方法の主な目的と想定される用途。(これには、当該ソリューションが有害な用途にどれくらい関連しているか、もしく有害な利用への転用可能性等の観点を含みます)

- 技術の性格や独自性: Google が提供する技術が独自性のあるものか、または一般に広く提供されているものであるか

- スケール(規模感): 当該テクノロジーの利用が重要な影響を持つかどうか

- Google の関与のあり方: どのような目的にも使える汎用的なツールの提供なのか、特定の顧客のためにツールを組み込むのか、もしくはカスタムソリューションの開発なのか

私たちが追求しない AI 利用

上記の基本方針に加えて、以下のような分野においては、AI の設計及び提供はしません。

- 総合的にみて有害または有害な可能性があるテクノロジー。重大なリスクが認められる場合、利点が大幅にリスクを上回る場合にのみ関与し、その場合も適切な安全上の制約を組み込みます。

- 人々に危害を与える、または人々への危害の直接的な助長を主目的とした、武器またはその他の技術。

- 国際的に認められた規範に反するような監視のために、情報を収集、利用するためのテクノロジー。

- 広く一般的に認められた国際法の理念や人権に反する用途のための技術。

Google は武器利用のための AI 開発を行なうことはありませんが、それ以外の領域において各国政府機関や軍事・防衛に関わる組織との協力はこれまで通り継続します。これらには、サイバーセキュリティ、トレーニング、隊員募集、退役軍人向け医療、人命捜索や救助などが該当します。このような協力は重要であり、Google は積極的にこれら組織の重要業務をサポートし、国防関係者や市民の安全を確保する方法を模索していきます。

長期的な視点での AI

以上が Google が今、選択している AI 開発へのアプローチですが、このテーマには対話の余地が残っていることを十分に理解しています。Google は AI の進化に伴い多様なステークホルダーと協力し、科学的に厳密で学際的なアプローチを使って、この分野における思慮深いリーダーシップの促進に努めます。また、AI 技術の向上や実践における学びを社会に広く共有します。

私たちは、上記の基本理念が Google の、そして、将来のAI 開発のための適切な基盤になるものと信じています。これは 2004 年の「Founders’ Letter (創業者の手紙)」が示した意志に沿うものでもあります。短期的な利益を犠牲にしても長期的な視点を採用する、と、当時、手紙に記しました。その考えは、今でも変わりません。