„Ads Safety Report 2024”: jak wykorzystujemy AI do ochrony naszych użytkowników

Nasz coroczny raport „Ads Safety Report” na temat bezpieczeństwa reklam to podsumowanie działań, które podjęliśmy w 2024 roku, aby zadbać o bezpieczeństwo naszych użytkowników i użytkowniczek oraz wydawców w ekosystemie reklamowym. To podsumowanie, które prezentujemy co roku, to także nasza motywacja do dalszych działań zapewniających bezpieczne reklamy w internecie. W 2023 roku pokazaliśmy, jak generatywna sztuczna inteligencja (AI) przyspieszyła egzekwowanie zasad - od szybszego sprawdzania treści po skuteczniejsze reagowanie na naruszenia. W 2024 roku AI zyskała kolejne zastosowanie: dzięki niej nie tylko wykrywamy fałszywe i niezgodne z zasadami reklamy, ale też pozwoliła nam zapobiegać i zawczasu blokować nieuczciwych reklamodawców w naszym ekosystemie.

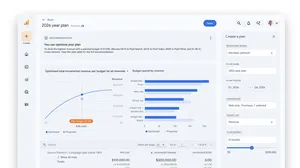

Skuteczniejsze egzekwowanie zasad dzięki bardziej zaawansowanym modelom

Podmioty nieprzestrzegające zasad nieustannie dostosowują swoje metody działania tak, aby nie były wykrywane przez nasze systemy, co wymaga od nas nowych rozwiązań i ciągłego doskonalenia już istniejących. Nasze wcześniejsze duże modele językowe (LLM) były trenowane w oparciu o ogromne zbiory danych, zaś najnowsze modele są znacznie wydajniejsze. W porównaniu do starszych modeli wystarczy im zaledwie ułamek potrzebnych wcześniej informacji, aby szybko rozpoznawać pojawiające się zagrożenia, a także identyfikować wzorce nadużyć oraz odróżniać uczciwe podmioty od oszustów. W zeszłym roku ulepszyliśmy nasze duże modele językowe. Wprowadziliśmy w nich ponad 50 usprawnień, które umożliwiają skuteczniejsze i bardziej precyzyjne egzekwowanie zasad na dużą skalę. Dzięki temu nasze zespoły mogły skupić się na bardziej złożonych problemach, a nasze modele językowe otrzymują bardziej szczegółowe dane treningowe, co w połączeniu pozwala nam lepiej zwalczać pojawiające się i zagrożenia.

Spójrzmy na przykład na egzekwowanie zasad dotyczących wydawców. Dzięki temu procesowi wydawcy mogą bezpiecznie zarabiać na swoich treściach poprzez wyświetlanie reklam – nasze modele oparte na AI przyczyniły się do wykrycia 97% niezgodnych z zasadami stron, względem których podjęliśmy działania. Dzięki tym modelom znacznie skrócił się czas sprawdzania witryn, co umożliwia wydawcom szybsze rozpoczęcie zarabiania na nich, a jednocześnie zapobiega wyświetlaniu reklam na stronach naruszających zasady.

Zapobiegamy wyświetlaniu reklam niezgodnych z zasadami w naszym ekosystemie

Duże modele językowe nie tylko usprawniły egzekwowanie zasad, ale też sprawiły, że zapewniamy bardziej proaktywną niż kiedykolwiek wcześniej ochronę przed nadużyciami. Narzędzia oparte na AI przyspieszają prowadzenie złożonych dochodzeń, pozwalają nam wykrywać nieuczciwe podmioty oraz osoby wielokrotnie naruszające zasady, a także powstrzymywać ich działania. Nasze wysiłki w tym zakresie pozwoliły nam zapobiec wyświetlaniu użytkownikom miliardów reklam naruszających zasady oraz pomóc uczciwym reklamodawców szybciej dotrzeć do ich grupy docelowej.

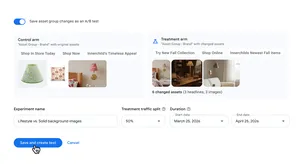

Jednym ze sposobów, który umożliwia nam zwalczanie oszustw reklamowych na wczesnym etapie na tak dużą skalę, to sygnały ostrzegające przed potencjalnym zagrożeniem, takim jak podszywanie się pod inne firmy czy podanie nieprawidłowych danych do płatności. Dzięki zasadom wprowadzonym w 2024 roku, dziś jesteśmy w stanie wykryć potencjalne zagrożenia już na etapie zakładania konta przez nieuczciwego reklamodawcę:w ostatnim roku zawiesiliśmy łącznie ponad 39,2 mln takich kont.

Proces weryfikacji tożsamości reklamodawcy to kolejna ważna wprowadzona zasada, która zapobiega ponownej rejestracji zawieszonych kont nieuczciwych reklamodawców, a także zapewnia transparentne dane dotyczące wyświetleń danej reklamy. Stosujemy ten proces w ponad 200 krajach i regionach, a średnio ponad 90% reklam wyświetlanych użytkownikom w Google pochodzi od zweryfikowanych reklamodawców. Nadal zwiększamy tę liczbę i codziennie weryfikujemy konta, gdy nowi reklamodawcy dołączają do naszej platformy.

Dostosowywanie działań mających na celu zwalczanie pojawiających się oszustw

Od dnia powstania internetu walczymy z wyrafinowanymi metodami oszustw wykorzystującymi coraz to nowsze techniki do ataków na nasze systemy – 2024 rok nie był wyjątkiem. Podjęliśmy działania na rzecz wzmocnienia naszych zabezpieczeń, aby chronić się przed nieuczciwymi podmiotami. W tym celu rozszerzyliśmy i zaostrzyliśmy nasze zasady, wdrożyliśmy zespoły szybkiego reagowania oraz udoskonaliliśmy nasze systemy wykrywania, aby ograniczyć rozprzestrzenianie się oszustw. Zdajemy sobie sprawę, że jest to wyzwanie dla całej branży, dlatego usprawniliśmy wymianę informacji między branżami – dołączyliśmy do inicjatywy Global Signal Exchange zapoczątkowanej przez organizację Global Anti-Scam Alliance.

Jednym z powszechnych trendów obejmujących całą branżę była rosnąca liczba reklam, w których podszywano się pod osoby publiczne – oszuści wykorzystywali wygenerowane przez AI obrazy i dźwięki, które sugerowały powiązania z celebrytami i w ten sposób promowały oszustwa. Chcąc stawić czoła temu zjawisku, szybko powołaliśmy specjalny zespół składający się z ponad 100 ekspertów i ekspertek, który zajmował się analizowaniem takich reklam - wynik ich pracy to zaktualizowanie naszych zasad dotyczących wprowadzania użytkowników w błąd. Pozwoliło nam na szybsze zawieszanie kont reklamodawców nadużywających naszych usług. W efekcie zawiesiliśmy na stałe ponad 700 tysięcy tego typu kont, co przełożyło się na 90% spadek tego typu nadużyć w ubiegłym roku. Choć cieszymy się z tych wyników, wciąż nieustannie robimy wszystko, aby zapobiegać takim oszustwom.

To tylko jeden przykład naszych działań mających na celu walkę z różnego rodzaju oszustwami reklamowymi na świecie. W 2024 roku zablokowaliśmy lub usunęliśmy 415 mln reklam i zawiesiliśmy ponad 5 mln kont z powodu naruszenia naszych zasad reklamowych.

Stoimy na straży integralności wyborów na całym świecie

Rok 2024 przebiegał pod znakiem wyborów, które dotyczyły niemal połowy ludzi na całym świecie. Dlatego nasze działania na rzecz wspierania uczciwości wyborów były niezwykle istotne. Pracowaliśmy m.in. nad rozszerzeniem na nowe kraje wymagań dotyczących weryfikacji tożsamości i przejrzystości dla reklamodawców wyświetlających reklamy wyborcze. Wprowadziliśmy m.in. wyświetlanie w reklamach wyborczych informacji „Opłacone przez” oraz udostępniliśmy publicznie raport przejrzystości na temat reklam politycznych. Dzięki temu użytkownicy na całym świecie są w stanie rozpoznać reklamy wyborcze i sprawdzić, kto za nie zapłacił. Co więcej, jako pierwsi na świecie wprowadziliśmy obowiązek informowania użytkowników o pojawiających się w reklamach wyborczych treściach wygenerowanych przez AI.

Tylko w minionym roku zweryfikowaliśmy ponad 8900 nowych reklamodawców wyświetlających reklamy wyborcze i usunęliśmy 10,7 mln reklam wyborczych z niezweryfikowanych kont. Nieustannie egzekwowaliśmy też na całym świecie nasze zasady względem fałszywych twierdzeń związanych z wyborami.

Rok 2024 w liczbach: niezaprzeczalna pomoc sztucznej inteligencji

W 2024 roku:

- Usunęliśmy ponad 5,1 mld reklam, ograniczyliśmy wyświetlanie ponad 9,1 mld reklam i zawiesiliśmy ponad 39,2 mln kont reklamodawców.

- Zablokowaliśmy lub ograniczyliśmy wyświetlanie reklam na 1,3 mld stron wydawców i podjęliśmy szerzej zakrojone działania związane z egzekwowaniem zasad na poziomie witryny w przypadku ponad 220 tysięcy witryn wydawców.

- Kontynuowaliśmy prace nad udoskonalaniem naszych zasad dotyczących reklam i wydawców i w efekcie wprowadziliśmy w nich ponad 30 aktualizacji.

Sytuacja w zakresie bezpieczeństwa reklam ciągle się zmienia. Wpływają na nią przełomy technologiczne, takie jak postępy w dziedzinie AI czy nowe metody oszustw, a także światowe wydarzenia -, wszystko to wymaga ciągłej czujności i elastyczności od naszej branży. W tym dynamicznym środowisku stawiamy czoła licznym wyzwaniom poprzez wdrażanie najnowocześniejszych technologii oraz współpracę z partnerami, aby zapewnić bezpieczne środowisko online wszystkim użytkownikom.