Gemini 2.0: nasz nowy model agenta AI

Wiadomość od Sundara Pichaia, prezesa Google i Alphabet:

Dostęp do informacji jest podstawą postępu ludzkości. Właśnie dlatego od ponad 26 lat naszą misją jest porządkowanie ich globalnego zasobu oraz uczynienie ich przystępnymi i przydatnymi. W tym celu nieustannie przesuwamy granice sztucznej inteligencji.

Taka była nasza wizja, gdy w grudniu ubiegłego roku wprowadziliśmy model Gemini 1.0. Po raz pierwszy opracowaliśmy jego natywnie multimodalne wersje, 1.0 i 1.5, znacznie usprawniając obsługę multimodalności i długich kontekstów. Przekłada się to na lepsze interpretowanie i możliwość przetwarzania znacznie większej ilości informacji zawartych w tekstach, materiałach wideo, na obrazach oraz w dźwięku i kodzie.

Teraz Gemini jest narzędziem używanym przez miliony deweloperów. Pomaga nam rozwijać wszystkie 7 naszych rodzin produktów, z których korzystają 2 miliardy użytkowników, i tworzyć nowe. Ceniona przez wiele osób usługa NotebookLM jest doskonałym przykładem możliwości, jakie dają funkcje multimodalne i długi kontekst.

W zeszłym roku inwestowaliśmy w rozwój bardziej agentowych modeli, dzięki czemu potrafią one lepiej rozumieć otaczający nas świat, myśleć wiele kroków naprzód i podejmować działania w naszym imieniu, pod naszym nadzorem.

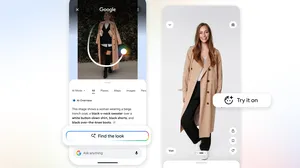

Dziś z radością wkraczamy w kolejną erę modeli opracowanych z myślą o nowej epoce agentowej: przedstawiamy Gemini 2.0, nasz najbardziej zaawansowany model. Dzięki nowym osiągnięciom w zakresie multimodalności, takim jak natywne generowanie obrazu i dźwięku czy korzystanie z narzędzi natywnych, będziemy mogli tworzyć nowe agenty sztucznej inteligencji, pomagające w realizacji naszej wizji stworzenia uniwersalnego asystenta.

Właśnie oddajemy wersję 2.0 w ręce deweloperów i zaufanych testerów. Szybko pracujemy nad wprowadzeniem jej do naszych produktów, na czele z Gemini i wyszukiwarką. Od dziś nasz eksperymentalny model Gemini 2.0 Flash będzie dostępny dla wszystkich użytkowników Gemini. Wprowadzamy również nową funkcję o nazwie Deep Research, która wykorzystuje funkcje zaawansowanego rozumowania i długiego kontekstu, aby działać jako asystent badający złożone tematy i kompilujący raporty w imieniu użytkownika. Jest on już dostępny w Gemini Advanced.

Wpływ sztucznej inteligencji widać najbardziej w wyszukiwarce. Nasze przeglądy od AI docierają obecnie do miliarda ludzi, umożliwiając im zadawanie zupełnie nowych rodzajów pytań, a co za tym idzie – szybko stają się jedną z najpopularniejszych funkcji wyszukiwarki w historii. Kolejnym krokiem będzie wprowadzenie do przeglądów od AI zaawansowanych funkcji rozumowania modelu Gemini 2.0, aby jeszcze lepiej przetwarzać złożone zagadnienia i wieloetapowe pytania, a także kod, zaawansowane równania matematyczne i zapytania multimodalne. W tym tygodniu rozpoczęliśmy ograniczone testy, a na początku przyszłego roku rozszerzymy ich skalę. W nadchodzących 12 miesiącach będziemy także wprowadzać przeglądy od AI w kolejnych krajach i językach.

Usprawnienia modelu 2.0 są wynikiem dziesięcioletnich inwestycji w nasze zróżnicowane, kompleksowe podejście do innowacji w zakresie AI. Model ten jest oparty na specjalnie dostosowanym sprzęcie, takim jak nasze procesory TPU szóstej generacji – Trillium. Były one wykorzystywane w całym procesie wnioskowania i trenowania modelu Gemini 2.0, a dziś są ogólnie dostępne dla klientów, aby mogli wykorzystać ich niezwykłe możliwości.

Podczas gdy model Gemini 1.0 służył do porządkowania i interpretowania informacji, Gemini 2.0 ma sprawić, że będą one znacznie bardziej przydatne. Z niecierpliwością wyczekuję kolejnych etapów rozwoju sztucznej inteligencji.

-Sundar

W ostatnim roku osiągnęliśmy kolejne niezwykłe postępy w dziedzinie rozwoju sztucznej inteligencji. Dzisiaj wprowadzamy pierwszy model z serii Gemini 2.0: wersję eksperymentalną Gemini 2.0 Flash. Jest to wszechstronny model wyróżniający się niskimi opóźnieniami i lepszą wydajnością, wykorzystujący nasze najnowsze technologie na dużą skalę.

Chcemy też podzielić się najnowszymi osiągnięciami w zakresie naszych badań dotyczących agentów AI, prezentując prototypy, których działanie jest możliwe dzięki natywnym funkcjom multimodalnym Gemini 2.0.

Gemini 2.0 Flash

Gemini 2.0 Flash wykorzystuje wszystkie możliwości wersji 1.5 Flash, czyli naszego najpopularniejszego do tej pory modelu dla deweloperów, który oferował jeszcze lepszą wydajność z porównywalnie szybkim czasem odpowiedzi. Model 2.0 Flash osiąga w kluczowych testach nawet lepsze wyniki niż 1.5 Pro i działa dwukrotnie szybciej, a do tego ma nowe funkcje. Poza multimodalnymi danymi wejściowymi, takimi jak obrazy, filmy i dźwięki, model 2.0 Flash obsługuje teraz także multimodalne dane wyjściowe – natywnie generowane obrazy połączone z tekstem oraz sterowalnym dźwiękiem TTS w wielu językach. Może również natywnie wywoływać narzędzia takie jak wyszukiwarka Google, wykonywać kod oraz uruchamiać zewnętrzne funkcje określone przez użytkownika.

Zależy nam na tym, żeby nasze modele były bezpieczne i jak najszybciej dostępne dla użytkowników. Od miesiąca udostępniamy wczesne, eksperymentalne wersje Gemini 2.0 i otrzymujemy wiele świetnych opinii od deweloperów.

Model eksperymentalny Gemini 2.0 Flash jest teraz dostępny dla deweloperów w ramach interfejsu Gemini API w Google AI Studio oraz Vertex AI. Wszyscy deweloperzy mogą korzystać z multimodalnych danych wejściowych i generowania tekstu. Partnerzy uczestniczący w programie wcześniejszego dostępu mogą natomiast używać takich funkcji jak zamiana tekstu na mowę czy natywne generowanie obrazów. Ogólne udostępnienie nowego modelu, wraz z dodatkowymi rozmiarami, planujemy na styczeń.

Aby ułatwić deweloperom tworzenie dynamicznych i interaktywnych aplikacji, wprowadzamy również nowy interfejs Multimodal Live API, który obsługuje w czasie rzeczywistym dane wejściowe w postaci dźwięku oraz strumieni wideo, a także pozwala na korzystanie z wielu połączonych narzędzi. Więcej informacji na temat modelu 2.0 Flash i interfejsu Multimodal Live API można znaleźć na naszym blogu dla deweloperów.

Gemini 2.0 w aplikacji Gemini, naszym asystencie AI

Od dzisiaj użytkownicy Gemini na całym świecie mogą też korzystać ze zoptymalizowanej pod kątem czatu eksperymentalnej wersji modelu 2.0 Flash, wybierając go w menu w aplikacji internetowej na komputerze lub telefonie. Wkrótce będzie on również dostępny w aplikacji mobilnej Gemini. Dzięki nowemu modelowi asystent Gemini będzie jeszcze bardziej pomocny i przydatny.

Na początku przyszłego roku Gemini 2.0 pojawi się w kolejnych usługach Google.

Funkcje agentów AI w modelu Gemini 2.0

Wszystkie funkcje modelu Gemini 2.0 Flash – takie jak natywna obsługa działań w interfejsie użytkownika, analiza multimodalna, rozumienie długiego kontekstu, śledzenie i planowanie skomplikowanych instrukcji, wywoływanie złożonych funkcji, natywne wykorzystanie narzędzi czy mniejsze opóźnienia – współpracują ze sobą, aby zapewnić dostęp do nowej klasy możliwości związanych z agentami AI.

Praktyczne wdrożenie agentów AI stwarza wiele ekscytujących możliwości. Prowadzimy w tym zakresie badania, wykorzystując różne prototypy, które mogą ułatwić użytkownikom wykonywanie zadań i realizację celów. Wśród nich jest na przykład nowa wersja naszego prototypu Project Astra, w którym badamy możliwość wdrożenia w przyszłości uniwersalnego asystenta AI. Kolejne prototypy to Project Mariner, w ramach którego sprawdzamy, jak mogą wyglądać interakcje między człowiekiem a agentem AI (na początek w przeglądarce), oraz Jules, oparty na AI agent kodujący, który może pomagać deweloperom.

Nadal jesteśmy na wczesnym etapie prac, ale cieszymy się, że nasi zaufani mogą już korzystać z nowych funkcji, dzięki czemu my sami możemy wiele się dowiedzieć, aby móc później wdrożyć te produkty dla szerszego grona odbiorców.

Project Astra: agenci korzystający z analizy multimodalnej do rozumienia rzeczywistego świata

Od zaprezentowania prototypu Project Astra na konferencji I/O zbieramy opinie naszych zaufanych testerów korzystających z tego rozwiązania na telefonach z Androidem. Dzięki ich cennym uwagom udało się nam lepiej zrozumieć, jak w praktyce mógłby działać uniwersalny asystent AI, biorąc pod uwagę także kwestie dotyczące bezpieczeństwa i etyki. Oto ulepszenia, które wprowadziliśmy w najnowszej wersji z Gemini 2.0:

- Lepsze rozmowy: Project Astra może teraz rozmawiać w wielu językach oraz mieszając języki. Lepiej rozpoznaje też akcenty i nietypowe słowa.

- Obsługa nowych narzędzi: dzięki modelowi Gemini 2.0 prototyp Project Astra może korzystać z wyszukiwarki Google, Obiektywu oraz Map, co sprawia, że może być znacznie bardziej przydatny na co dzień jako asystent.

- Lepsza pamięć: Project Astra ma teraz rozszerzone możliwości zapamiętywania informacji, ale jednocześnie zapewnia użytkownikowi pełną kontrolę. Potrafi teraz zapamiętać informacje z 10 minut podczas sesji oraz przypominać sobie informacje z wcześniejszych rozmów, co pozwala na lepszą personalizację.

- Mniejsze opóźnienia: nowe funkcje strumieniowania i natywnego rozpoznawania dźwięków pozwalają agentowi na rozumienie mowy w sposób zbliżony do człowieka.

Pracujemy nad wprowadzeniem tych funkcji do usług Google takich jak aplikacja Gemini, czyli do naszego asystenta AI, ale także chcemy je wdrożyć na innych platformach – np. na okularach. Do naszego programu zaufanych testów zapraszamy też nowe osoby – w tym niewielką grupę użytkowników, która już wkrótce zacznie testować Project Astra na prototypie okularów.

Project Mariner: agenci pomagający w wykonywaniu złożonych zadań

Project Mariner to wczesny prototyp badawczy zbudowany przy użyciu Gemini 2.0, który bada przyszłość interakcji między człowiekiem a agentem, zaczynając od przeglądarki. Jako prototyp badawczy jest w stanie zrozumieć i przeanalizować informacje znajdujące się na ekranie przeglądarki, w tym piksele i elementy internetowe, takie jak tekst, kod, obrazy i formularze, a następnie wykorzystuje te informacje za pośrednictwem eksperymentalnego rozszerzenia Chrome do wykonywania zadań za użytkownika.

W teście porównawczym WebVoyager, który służy do oceny wydajności agentów w wykonywaniu kompleksowych zadań internetowych w świecie rzeczywistym, Project Mariner osiągnął znakomity wynik 83,5%, działając w trybie pojedynczego agenta.

Jest jeszcze wcześnie, ale Project Mariner pokazuje, że nawigacja w przeglądarce staje się technicznie możliwa, i chociaż obecnie agent nie zawsze jest dokładny i wykonuje zadania powoli, to z czasem jego działanie ulegnie szybkiej poprawie.

Aby budować to rozwiązanie bezpiecznie i odpowiedzialnie, prowadzimy aktywne badania nad nowymi rodzajami ryzyka i środkami zaradczymi, jednocześnie nie wykluczając udziału ludzi. Przykładowo, Project Mariner może pisać, przewijać lub klikać tylko w aktywnej karcie przeglądarki i prosi użytkownika o ostateczne potwierdzenie przed podjęciem pewnych wrażliwych działań, takich jak zakup.

Obecnie zaufani testerzy rozpoczynają testowanie narzędzia Project Mariner przy użyciu eksperymentalnego rozszerzenia Chrome, a jednocześnie podejmujemy rozmowy z ekosystemem internetowym.

Jules: agenci dla deweloperów

Kolejną kwestią, jaką badamy, jest to, w jaki sposób agenci AI mogą pomóc deweloperom, przy użyciu Jules – eksperymentalnego agenta kodującego opartego na sztucznej inteligencji, który jest zintegrowany bezpośrednio z przepływem pracy platformy GitHub. Potrafi on rozwiązywać problemy, opracowywać plany i je realizować, a wszystko to pod kierunkiem i nadzorem dewelopera. Projekt ten jest częścią naszego długoterminowego celu stworzenia agentów AI, którzy będą pomocni we wszystkich dziedzinach, w tym w kodowaniu.

Więcej informacji na temat tego trwającego eksperymentu można znaleźć w naszym wpisie na blogu dla deweloperów.

Agenci w grach i innych dziedzinach

Google DeepMind ma długą historię używania gier do pomagania modelom sztucznej inteligencji w nauce przestrzegania zasad, planowania i logiki. W zeszłym tygodniu na przykład wprowadziliśmy Genie 2, model sztucznej inteligencji, który może tworzyć nieskończoną liczbę grywalnych światów 3D – wszystkie na podstawie jednego obrazu. Bazując na tej tradycji, stworzyliśmy agentów używających Gemini 2.0, którzy mogą pomóc użytkownikowi w poruszaniu się po wirtualnym świecie gier wideo. Agenci potrafią wyciągać wnioski na temat gry wyłącznie w oparciu o akcję na ekranie i sugerować w rozmowie w czasie rzeczywistym. co robić dalej.

Współpracujemy z wiodącymi twórcami gier, takimi jak Supercell, aby zbadać, jak działają ci agenci, testując ich zdolność do interpretowania zasad i wyzwań w różnych grach – od strategii, takich jak „Clash of Clans”, po gry farmerskie, np. „Hay Day”

Poza pełnieniem roli wirtualnych towarzyszy w grach, agenci ci mogą nawet korzystać z wyszukiwarki Google, aby zapewnić graczowi dostęp do bogatej wiedzy na temat gier w Internecie.

Oprócz badania możliwości agentów w świecie wirtualnym eksperymentujemy z agentami, którzy mogą pomóc w świecie fizycznym, stosując możliwości rozumowania przestrzennego Gemini 2.0 w robotyce. Chociaż jest jeszcze wcześnie, jesteśmy podekscytowani potencjałem agentów, którzy mogą pomagać w środowisku fizycznym.

Więcej informacji na temat tych prototypów badawczych i eksperymentów można znaleźć na stronie labs.google.

Odpowiedzialne budowanie w erze agentów

Gemini 2.0 Flash i prototypy badawcze pozwalają nam testować i ulepszać nowe funkcje w czołówce badań nad sztuczną inteligencją, które ostatecznie sprawią, że produkty Google będą bardziej pomocne.

Rozwijając te nowe technologie, zdajemy sobie sprawę z odpowiedzialności, jaka się z tym wiąże, a także z wielu pytań, jakie korzystanie z agentów AI nasuwa w zakresie bezpieczeństwa i ochrony. Dlatego też przyjmujemy eksploracyjne i stopniowe podejście do rozwoju, prowadząc badania nad wieloma prototypami, wdrażając kolejne szkolenia w zakresie bezpieczeństwa, współpracując z zaufanymi testerami i ekspertami zewnętrznymi, a także przeprowadzając szeroko zakrojone oceny ryzyka i bezpieczeństwa.

Na przykład:

- W ramach procesu bezpieczeństwa współpracujemy z naszym Komitetem ds. Odpowiedzialności i Bezpieczeństwa (RSC), istniejącą od wielu lat wewnętrzną grupą kontrolną, aby zidentyfikować i zrozumieć potencjalne zagrożenia.

- Możliwości rozumowania Gemini 2.0 umożliwiły znaczny postęp w naszym podejściu opartym na red teamingu z wykorzystaniem sztucznej inteligencji, w tym poszerzenie zwykłego wykrywania zagrożeń o automatyczne generowanie ocen i danych szkoleniowych w celu ich ograniczenia. Oznacza to, że możemy skuteczniej optymalizować model pod kątem bezpieczeństwa na dużą skalę.

- Ponieważ multimodalność Gemini 2.0 zwiększa złożoność potencjalnych danych wyjściowych, będziemy nadal oceniać i szkolić dane wyjściowe obrazu i dźwięku modeli, aby zwiększać bezpieczeństwo.

- W ramach projektu Project Astra badamy potencjalne środki zaradcze przeciwko niezamierzonemu udostępnianiu przez użytkowników wrażliwych informacji agentowi, a także wbudowaliśmy mechanizmy kontroli prywatności, które ułatwiają użytkownikom usuwanie sesji. Kontynuujemy również badania nad sposobami zapewnienia, że agenci AI działają jako wiarygodne źródła informacji i nie podejmują niezamierzonych działań w imieniu użytkownika.

- W ramach projektu Project Mariner pracujemy nad tym, aby model nauczył się nadawać priorytet instrukcjom użytkownika nad próbami wstrzyknięcia monitu przez osoby trzecie, aby potrafił zidentyfikować potencjalnie złośliwe instrukcje ze źródeł zewnętrznych i zapobiegał nadużyciom. Pozwala to uniknąć narażenia użytkowników na oszustwa i próby phishingu przez m.in. złośliwe instrukcje ukryte w wiadomościach e-mail, dokumentach lub witrynach internetowych.

Jesteśmy głęboko przekonani, że jedynym sposobem na zbudowanie sztucznej inteligencji jest odpowiedzialne postępowanie od samego początku i w miarę rozwoju naszych modeli oraz agentów będziemy nadal priorytetowo traktować bezpieczeństwo i odpowiedzialność jako kluczowy element naszego procesu rozwoju modeli.

Gemini 2.0, agenci AI i nie tylko

Dzisiejsze aktualizacje wyznaczają nowy rozdział dla naszego modelu Gemini. Wraz z wydaniem Gemini 2.0 Flash i serii prototypów badawczych badających możliwości agentów, osiągnęliśmy niezwykle ważny etap w rozwoju Gemini. Z niecierpliwością czekamy na dalsze bezpieczne odkrywanie wszystkich możliwości pojawiających się w miarę dążenia do budowania AGI.