Google I/O 2025: od badań do rzeczywistości

Uwaga: poniżej znajduje się zredagowany zapis słów Sundara Pichaia, prezesa Google, wygłoszonych podczas konferencji Google I/O 2025. Tekst został rozszerzony o dodatkowe informacje dotyczące , ogłoszeń zaprezentowanych na scenie. Pełne podsumowanie nowości znajdziesz w naszym zestawieniu.

Zazwyczaj nie ujawniamy zbyt wiele nowości w tygodniach poprzedzających konferencję I/O- zależy nam by prezentacja najważniejszych modeli odbywała się na scenie. Ale w erze Gemini równie dobrze moglibyśmy zaprezentować nasz najinteligentniejszy model w zwykły marcowy wtorek albo ogłosić przełom taki jak AlphaEvolve, tydzień wcześniej.

Naszym celem jest jak najszybsze udostępnianie Ci najlepszych modeli i usług — i robimy to szybciej niż kiedykolwiek wcześniej.

Nieustanny postęp w rozwoju modeli

Szczególnie cieszy mnie szybkie tempo rozwoju modeli. Wyniki Elo, będące miarą ich postępu, w porównaniu z pierwszą generacją modelu Gemini Pro wzrosły o ponad 300 punktów. Obecnie Gemini 2.5 Pro zajmuje pierwsze miejsce w rankingu LMArena we wszystkich kategoriach.

Nieustannie udoskonalamy nasze modele dzięki światowej klasy infrastrukturze. Nasz procesor TPU siódmej generacji, Ironwood, to pierwsze urządzenie zaprojektowane specjalnie z myślą o zadaniach AI wymagających zaawansowanego rozumowania i wnioskowania na dużą skalę. Oferuje 10-krotnie wyższą wydajność niż jego poprzednik i zapewnia imponujące 42,5 eksaflopa mocy obliczeniowej na jeden pod.

Dzięki tej infrastrukturze, w tym TPU, jesteśmy w stanie tworzyć zdecydowanie szybsze modele przy coraz niższych kosztach. Raz za razem dostarczamy najlepsze modele w optymalnych cenach. Google nie tylko prowadzi na froncie Pareto - my ten front zasadniczo przesuwamy.

Świat wdraża AI

Zaawansowana sztuczna inteligencja staje się dostępna dla każdego, wszędzie. Świat dynamicznie na to reaguje, wdrażając AI szybciej niż kiedykolwiek wcześniej. Oto kilka ważnych wskaźników postępu:

- W analogicznymokresie ubiegłego roku nasze usługi i interfejsy API przetwarzały 9,7 biliona tokenów miesięcznie. Obecnie liczba ta przekracza 480 bilionów – to aż 50-krotny wzrost.

- Z Gemini korzysta ponad 7 milionów programistów - 5 razy więcej niż rok temu. Wykorzystanie modeli Gemini w Vertex AI wzrosło 40-krotnie.

- Aplikacja Gemini osiągnęła ponad 400 milionów aktywnych użytkowników miesięcznie. Szczególnie duży wzrost zaangażowania obserwujemy w przypadku modeli z serii 2.5.- liczba użytkowników korzystających z modelu 2.5 Pro w aplikacji Gemini wzrosła o 45%.

Od badań do rzeczywistości

Wszystko to oznacza, że wkraczamy w nową fazę transformacji ku platformie opartej na AI. Dziesięciolecia badań stają się dziś rzeczywistością — dostępną dla ludzi, firm i społeczności na całym świecie.

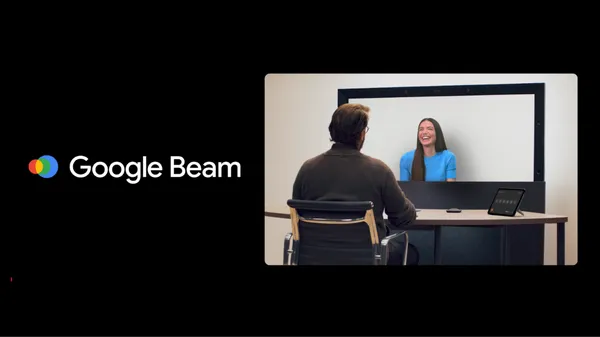

Project Starline → Google Beam + tłumaczenie mowy

Kilka lat temu podczas konferencji I/O zaprezentowaliśmy Project Starline, przełomową technologię trójwymiarowej komunikacji wideo. Jej celem było stworzenie wrażenia, że rozmówcy znajdują się w tym samym pomieszczeniu, nawet jeśli dzieli ich znaczna odległość/setki kilometrów.

Nieustannie rozwijamy nowe technologie, a dziś ogłaszamy kolejny rozdział tej historii: Google Beam, nową platformę do komunikacji wideo opartą na AI. Beam wykorzystuje zaawansowany model wideo, który przekształca dwuwymiarowe strumienie wideo w realistyczny obraz 3D. Dzięki sześciu kamerom i AI, łączącym strumienie wideo możliwe jest odwzorowanie postaci rozmówcy na trójwymiarowym wyświetlaczu pola świetlnego. Technologia ta umożliwia niemal idealne śledzenie ruchów głowy z dokładnością do milimetra przy 60 klatkach na sekundę w czasie rzeczywistym. W efekcie rozmowa jest bardziej naturalna i zapewnia realistyczne wrażenia. Wspólnie z firmą HP planujemy udostępnić pierwsze urządzenia Google Beam klientom jeszcze w tym roku.

Z biegiem lat w Google Meet wprowadziliśmy wiele funkcji zwiększających zangażowanie użytkowników. Jedną z nich jest nowatorska technologia, która pomaga ludziom przełamywać bariery językowe - tłumaczenie mowy w czasie zbliżonym do rzeczywistego. System nie tylko przekłada wypowiedzi, ale także dopasowuje brzmienie i ton głosu rozmówcy, a nawet jego mimikę, co przybliża nas do naturalnej i płynnej komunikacji między językami. Tłumaczenie z języka angielskiego i hiszpańskiego jest już stopniowo udostępniane subskrybentom Google AI Pro i Ultra w wersji beta. W nadchodzących tygodniach pojawią się kolejne języki, a jeszcze w tym roku funkcja ta trafi do wczesnych testów klientów biznesowych korzystających z Workspace.

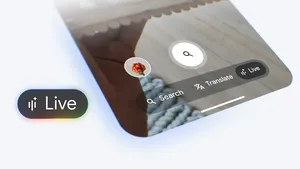

Project Astra → Gemini Live

Jednym z najbardziej ekscytujących projektów badawczych po raz pierwszy zaprezentowanych na konferencji I/O, był Project Astra. Jego celem było sprawdzenie czy możliwe jest stworzenie uniwersalnego asystenta AI, który rozumie otaczający nas świat. W ramach tego projektu powstały funkcje aparatu i udostępniania ekranu, które są teraz częścią Gemini Live, Użytkownicy wykorzystują je na wiele kreatywnych sposobów – od przygotowania do rozmowy kwalifikacyjnej po opracowanie planu treningów przed maratonem. Ta funkcja jest już dostępna dla wszystkich użytkowników Androida, a od dziś stopniowo udostępniamy ją też użytkownikom iOS.

Tego typu rozwiązania wprowadzamy również do innych usług, w tym do wyszukiwarki.

Project Mariner → tryb agenta

Agentów definiujemy jako systemy, które łączą zaawansowaną inteligencję modeli AI z dostępem do narzędzi, dzięki czemu mogą działać w Twoimi imieniu - zawszepod Twoją kontrolą.

Nasz prototyp badawczy, Project Mariner, to ważny krok w kierunku rozwijania agentów zdolnych do obsługi komputera, interakcji w internecie i wykonywania różnorodnych zadań za użytkownika. Udostępniliśmy wcześną wersję prototypu badawczego już w grudniu i od tego czasu poczyniliśmy wiele postępów dzięki nowym funkcjom wielozadaniowości oraz metodzie „naucz i powtarzaj”. Oznacza to, że wystarczy raz pokazać agentowi zadanie, by nauczył się wykonywać podobne w przyszłości.

Funkcje Project Mariner związane z obsługą komputera są już dostępne dla programistów poprzez interfejs Gemini API. Z prototypu korzystają już zaufani testerzy, tacy jak Automation Anywhere i UiPath, a latem planujemy udostępnić go szerszemu gronu użytkowników

Możliwość wykorzystania komputera to tylko jedna z wielu funkcji które musimy zbudować, aby ekosystem agentów mógł się rozwijać.

Pracujemy również nad kluczowymi elementami infrastruktury. Jednym z nich jest otwarty protokół Agent2Agent, który umożliwia agentom komunikowanie się ze sobą. Innym opracowany przez firmę Anthropic protokół Model Context Protocol, który pozwala agentom uzyskiwać dostęp do innych usług. Dziś z przyjemnością ogłaszamy, że nasz interfejs Gemini API i pakiet SDK Gemini są teraz zgodne z narzędziami MCP.

Rozszerzamy też funkcje agentowe w takich produktach jak Chrome, wyszukiwarka Google i aplikacja Gemini. Przykładowo, nowy tryb agenta w aplikacji Gemini pomoże Ci zwiększyć produktywność. Jeśli szukasz mieszkania, agent może znaleźć ogłoszenia zgodne z Twoimi preferencjami na stronach takich jak Zillow, dostosować filtry, skorzystać z MCP, aby uzyskać dostęp do ofert, a nawet umówić wizytę.

Wkrótce udostępnimy eksperymentalną wersję tego trybu subskrybentom aplikacji Gemini. To rozwiązanie szczególnie korzystne dla firm takich jak Zillow — pozwala dotrzeć do nowych klientów i zwiększyć współczynniki konwersji.

To nowy i dynamicznie rozwijający się obszar, dlatego chcemy sprawdzić, jak za pomocą agentów zapewnić największe korzyści użytkownikom i naszemu ekosystemowi.

Moc personalizacji

Aby badania miały realny wpływ, muszą być naprawdę użyteczne. Właśnie dlatego personalizacja jest tak kluczowa. Pracujemy nad tym, aby te możliwości stały się rzeczywistością, dzięki temu co nazywamy spersonalizowanym kontekstem. Jeśli wyrazisz na to zgodę, modele Gemini mogą korzystać z odpowiednich informacji o Twoich osobistych preferencjach w aplikacjach Google w sposób prywatny, przejrzysty i w pełni pod Twoją kontrolą.

Dobrym przykładem zastosowania spersonalizowanego kontekstu jest nowa funkcja inteligentnych odpowiedzi w Gmailu. Jeśli znajomy wyśle Ci e-maila z prośbą o podanie trasy, którą kiedyś pokonałaś lub pokonałeś, Gemini będzie mógł przeszukać Twoje wcześniejsze wiadomości oraz pliki na Dysku Google – na przykład plany podróży zapisane w Dokumentach – i zaproponować odpowiedź zawierającą konkretne, trafne informacje.

Co więcej, taka odpowiedź będzie dopasowana do Twojego stylu – uwzględni typowe powitanie, ton wypowiedzi, a nawet ulubione zwroty, by brzmiała naturalnie i autentycznie.

Spersonalizowane inteligentne odpowiedzi trafią do subskrybentów jeszcze w tym roku. Wyobraź sobie, jak przydatny może być taki osobisty kontekst w wyszukiwarce, Gemini i innych usługach Google.

Tryb AI w wyszukiwarce

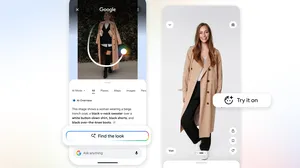

Modele Gemini sprawiają, że wyszukiwarka Google staje się coraz bardziej inteligentna, agentowa i dopasowana do indywidualnych potrzeb.

Od momentu wprowadzenia w zeszłym roku, funkcja AI Overview (przegląd od AI) została udostępniona ponad 1,5 miliarda użytkowników w 200 krajach i regionach. Użytkownicy, którzy z niej korzystają, są bardziej zadowoleni z wyników i częściej wracają do wyszukiwarki.

Na największych rynkach – takich jak Stany Zjednoczone i Indie – AI Overview odpowiada już za ponad 10% wzrost liczby zapytań, w których ta funkcja się pojawia. Co ważne, ten trend rośnie z czasem.

To jedna z najbardziej udanych innowacji w wyszukiwarce Google na przestrzeni ostatniej dekady.

Dla osób, które chcą w pełni wykorzystać możliwości AI w wyszukiwarce, wprowadzamy zupełnie nowy tryb AI. To zmienia sposób myślenia o wyszukiwaniu – pozwala zadawać bardziej złożone, wieloczłonowe pytania i uzyskiwać odpowiedzi, które uwzględniają zaawansowane rozumowanie.

Wczesne testy pokazały, że użytkownicy korzystający z trybu AI zadawali pytania nawet 2–3 razy dłuższe niż w tradycyjnej wyszukiwarce, a także częściej zadawali pytania uzupełniające. Nowy tryb dostępny jest w dedykowanej karcie wyszukiwarki.

Korzystam z niego regularnie – całkowicie zmienił sposób, w jaki wyszukuję informacje.

Z przyjemnością ogłaszamy, że od dziś tryb AI jest dostępny dla wszystkich użytkowników w Stanach Zjednoczonych.

Dzięki najnowszemu modelowi Gemini 2.5 odpowiedzi generowane przez AI są szybkie, trafne i spełniają wysokie oczekiwania użytkowników wyszukiwarki. W tym tygodniu model ten trafi bezpośrednio do wyszukiwarki.

Rozwijamy nasz najinteligentniejszy model: Gemini 2.5

Nasz najwydajniejszy i najbardziej zoptymalizowany model – Gemini 2.5 Flash – zyskał ogromną popularność wśród programistów dzięki swojej szybkości i niskim kosztom.

Najnowsza wersja 2.5 Flash jest lepsza niemal pod każdym względem – udoskonaliliśmy go w zakresie rozumowania, multimodalności, kodu oraz obsługi długiego kontekstu. W rankingu LMArena model ten zajmuje drugie miejsce, zaraz po 2.5 Pro.

Model Gemini 2.5 Pro również stale rozwijamy.

Wprowadzamy w nim nowy, ulepszony tryb rozumowania – Deep Think – który opiera się na naszych najnowszych badaniach z zakresu zaawansowanego myślenia i rozumowania, w tym technikach tzw. myślenia równoległego.

Bardziej osobista, proaktywna i zaawansowana aplikacja Gemini

Zwiększamy poziom personalizacji w Deep Research, umożliwiając przesyłanie własnych plików. Wkrótce dodamy także integrację z Dyskiem Google i Gmailem, co znacząco poszerzy możliwości tworzenia niestandardowych raportów badawczych.

Rozszerzamy również integrację z Canvas, co pozwala jednym kliknięciem generować dynamiczne infografiki, quizy, a nawet podcasty w wielu językach.

Obserwujemy też ciekawe zastosowania tzw. vibe codingu w Canvas – dzięki niemu coraz więcej osób tworzy funkcjonalne aplikacje po prostu rozmawiając z Gemini na czacie.

Jeśli chodzi o Gemini Live – funkcję, która zdobyła szczególne uznanie użytkowników – umożliwiamy teraz bezpłatne udostępnianie obrazu z aparatu i ekranu wszystkim użytkownikom, także na iOS. Wkrótce zostanie ona zintegrowana z najczęściej używanymi aplikacjami Google, aby jeszcze łatwiej można było z niej korzystać.

Postępy w modelach mediów generatywnych

Przedstawiamy nasz najnowszy, zaawansowany model do generowania filmów, Veo 3, który teraz ma wbudowaną funkcję generowania dźwięku. Wprowadzamy także Imagen 4, nasz najnowszy i najbardziej zaawansowany model do generowania obrazów. Obie te funkcje są dostępne w aplikacji Gemini, co otwiera zupełnie nowe możliwości kreatywne.

Wprowadziliśmy te możliwości dla twórców filmów w nowym narzędziu o nazwie Flow. Dzięki niemu możesz tworzyć filmowe klipy, a także rozwijać krótkie klipy w dłuższe sceny.

Szansa na poprawę jakości życia

Możliwości, jakie stwarza AI, są ogromne. To właśnie dzięki zaangażowaniu programistów, twórców technologii i innowatorów rozwiązujących codzienne problemy korzyści płynące z tej technologii mogą dotrzeć do jak największej liczby użytkowników. Szczególnie inspirujące jest myślenie o dzisiejszych badaniach które jutro staną się naszą rzeczywistością – od robotyki po technologie kwantowe, AlphaFold i Waymo.

Osobiście przekonałem się o tym niedawno, gdy odwiedzałem z rodzicami San Francisco. Chcieli przejechać się samochodem Waymo, który, jak się okazało, staje się jedną z najpopularniejszych atrakcji turystycznych w mieście. Korzystałem z tej technologii wcześniej ale tym razem zobaczyłem ją oczami mojego ojca, który ma ponad 80 lat. Był zachwycony. W tamtej chwili zrozumiałem, że postęp technologiczny nabiera zupełnie nowego znaczenia.

To przypomnienie o niesamowitej sile technologii – która potrafi inspirować, zachwycać i realnie zmieniać życie. Z niecierpliwością czekam na to, co jeszcze wspólnie stworzymy.