Ser ousado em IA significa ser responsável desde o início

Acreditamos que a nossa abordagem de Inteligência Artificial (AI) deve ser ousada e responsável ao mesmo tempo. Para nós, isto significa desenvolver a AI de uma forma que maximize os benefícios positivos para a sociedade ao mesmo tempo que responde aos desafios guiados pelos nossos Princípios de IA. Embora haja uma tensão natural entre os dois, acreditamos que é possível – e de fato é crítico – abraçar esta tensão de uma forma produtiva. A única forma de sermos verdadeiramente ousados a longo prazo é sermos responsáveis desde o primeiro momento.

Estamos a aplicar a IA com ousadia nos nossos produtos inovadores utilizados pelas pessoas em todo o lado, nos nossos avanços científicos e para ajudar a enfrentar os desafios da sociedade.

Nos nossos produtosA IA já está em muitos produtos que milhões (e em alguns casos milhares de milhões) de pessoas já usam, como o Google Maps, Google Tradutor, Google Lens e muito mais. E agora estamos a trazer a IA para ajudar as pessoas a estimular e auxiliar a sua criatividade com o Bard, a aumentar sua produtividade com as ferramentas do Workspace e a revolucionar a maneira como acedem ao conhecimento com a Experiência de Pesquisa Generativa (Search Generative Experience). Vários outros exemplos e experimentos iniciais de aplicações úteis podem ser encontrados no Google Labs.

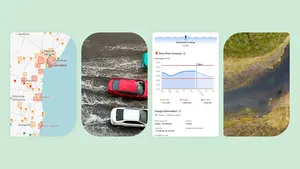

Para ajudar a enfrentar os desafios da sociedadeEstamos a aplicar a IA para mitigação e adaptação às mudanças climáticas: proporcionando previsões críticas sobre inundações - agora para mais de 20 países, acompanhando os avanços dos incêndios florestais em tempo real e ajudando a reduzir as emissões de carbono com a redução dos tempos de paragem no trânsito. Estamos também a aplicá-la para melhorar a saúde – incluindo cuidados maternais, tratamentos contra o cancro e monitorização da tuberculose. E, recentemente, anunciamos um grande novo modelo de linguagem que poderá ser uma ferramenta útil para os médicos: Med-PaLM. Ainda este ano, o Data Commons – um sistema que organiza dados de centenas de fontes e que informa várias abordagens para os principais desafios sociais, desde a sustentabilidade à saúde, empregabilidade e economia em muitos países – estará acessível através do Bard, tornando-o ainda mais útil.

No campo da investigaçãoA IA está a ajudar os cientistas em avanços significativos em muitos campos da física, ciência material e saúde que vão beneficiar a sociedade – por exemplo, o programa AlphaFold do Google DeepMind. O AlphaFold consegue prever de forma precisa a forma 3D de 200 milhões de proteínas, quase todas as proteínas catalogadas e conhecidas pela ciência – uma conquista que equivale a 400 milhões de anos de progresso de investigação em apenas algumas semanas. A IA está também a permitir empreendimentos ambiciosos como a nossa iniciativa de 1,000 idiomas – nós fizemos progressos excitantes em direção à nossa meta de dar suporte aos 1,000 idiomas mais faladas com o Universal Speech Model treinado em mais de 400 idiomas.

DesafiosEmbora seja emocionante ver estes avanços ousados, sabemos que a IA é ainda uma tecnologia emergente - e ainda há muito mais a fazer. Também é importante reconhecer que a IA tem potencial para piorar os desafios sociais já existentes - como o preconceito - e criar novos desafios à medida que se torna mais avançada e surgem novos usos, como a nossa própria pesquisa e a de outros que tem sido destacada. É por isso que acreditamos que é imperativo adotar uma abordagem responsável de IA guiada pelos Princípios de IA que estabelecemos pela primeira vez em 2018. Todos os anos, emitimos relatórios de progresso sobre como estamos a colocar em prática os nossos Princípios de IA, e que detalham exemplos. Este trabalho continua à medida que a IA se torna mais capaz, aprendemos com os utilizadores, novos usos das tecnologias, e partilhamos o que aprendemos.

Avaliação da informaçãoUma área que está no topo da atenção de muitos - incluindo a nossa - é a desinformação. A IA generativa torna mais fácil do que nunca criar novos conteúdos, mas levanta também questões adicionais sobre a confiança na informação online. É por isso que continuamos a desenvolver e a disponibilizar às pessoas ferramentas que permitem avaliar a informação online. Nos próximos meses, iremos adicionar uma nova ferramenta na Pesquisa Google: Acerca desta imagem. A funcionalidade Acerca desta imagem irá fornecer contexto importante como, quando e onde imagens semelhantes podem ter aparecido pela primeira vez e onde também foram vistas online, incluindo notícias, verificação de factos e redes sociais. Mais para o fim do ano, a ferramenta Acerca desta imagem estará disponível no Chrome e no Google Lens.

Princípios de IA em açãoÀ medida que aplicamos os nossos princípios de IA nos nossos produtos, começamos também a ver potenciais tensões quando falamos de ousadia e de responsabilidade. Por exemplo, o Tradutor Universal é um serviço experimental de dobragem em vídeo com recurso a IA que ajuda especialistas na tradução da voz de um orador com a correspondência dos movimentos labiais. Isto tem um enorme potencial em termos de aprendizagem e por sabermos dos riscos que isto pode representar nas mãos de pessoas mal-intencionadas, construímos o serviço com proteções para limitar o uso indevido e torná-lo apenas acessível a parceiros autorizados.

Outra maneira de cumprirmos os nossos Princípios de IA é com inovações que enfrentam os desafios à medida que surgem. Por exemplo, somos um dos primeiros da indústria a automatizar o adversarial testing usando Grandes Modelos de Linguagem (LLMs), o que melhorou significativamente a velocidade, a qualidade e a cobertura dos testes, permitindo que os especialistas em segurança se concentrem nos casos mais difíceis. Para ajudar a lidar com a desinformação, estaremos, em breve, a integrar novas inovações ao nível da proveniência dos dados para os nossos modelos generativos mais recentes. Também estamos a fazer progressos em ferramentas para detectar vozes sintetizadas – no nosso trabalho AudioLM, treinamos um classificador que pode detectar vozes sintetizadas nos nossos modelos de áudio com uma precisão de quase 99%.

Um esforço coletivoSabemos que desenvolver a IA com responsabilidade deve ser um esforço coletivo envolvendo investigadores, cientistas sociais, especialistas da indústria, governos, criadores, publisher se pessoas que usam IA nas suas vidas diárias.

Estamos a partilhar inovações com outros para aumentar o impacto, como por exemplo no caso da API Perspective que foi desenvolvida originalmente pelos nossos investigadores na Jigsaw para mitigar a toxicidade nos comentários online. Agora, estamos a aplicá-lo aos nossos Grandes Modelos de Linguagem (LLMs) - incluindo todos os modelos mencionados na Google I/O - e investigadores académicos o usaram-na para criar uma avaliação padrão de indústria usada por todos os LLMs mais significativos, incluindo modelos da OpenAI e da Anthropic.

Acreditamos que todos beneficiam de um vibrante ecossistema da web, hoje e no futuro. De forma a apoiar, vamos trabalhar com a comunidade web de várias formas para dar aos publishers da web a escolha e o controle sobre o seu conteúdo da web.

Parte do que torna a IA uma área de foco tão empolgante é que o potencial de beneficiar as pessoas e a sociedade em todos os locais é imenso e palpável, tal como o imperativo de a desenvolver e usar com responsabilidade. Muita coisa está a mudar e a evoluir à medida que a IA avança e mais pessoas a experimentam, a partilham, a desenvolvem e a usam. Estamos sempre a aprender a partir da nossa investigação, experiências, utilizadores e a comunidade em geral - e incorporamos o que aprendemos na nossa abordagem. Olhando para a frente, há muito para realizar e muito para acertar - juntos.

Gostaria de agradecer e reconhecer o trabalho inspirador e complexo dos meus colegas nas equipas de IA responsável, Inovação responsável, Google.org, Labs, Jigsaw, Google Research e Google DeepMind.