I 25 momenti migliori della Ricerca: dalle immagini all’IA

Quando Google è stata lanciata 25 anni fa, era ben lontana dall’essere il primo motore di ricerca. Tuttavia, la Ricerca Google è diventata rapidamente nota per la sua capacità di connettere le persone alle informazioni esatte che cercano, più velocemente di quanto avessero mai immaginato.

Nel corso degli anni, abbiamo continuato a innovare e a migliorare la Ricerca Google di giorno in giorno. È stata una sorta di viaggio: dall’ideazione di modalità completamente nuove per effettuare ricerche, all’aiutare milioni di attività commerciali a entrare in contatto con i clienti attraverso i risultati di ricerca e gli annunci (cominciando con la promozione di un’attività mediante AdWords nel 2001), fino ai divertenti doodle e easter egg.

Per il nostro 25° compleanno, stiamo ripercorrendo alcuni dei traguardi che hanno reso Google più utile nei momenti più importanti e che hanno giocato un ruolo significativo nel rendere Google ciò che è oggi. Potete scoprire di più sulla nostra storia nel sito L’evoluzione della Ricerca.

2001: Google Immagini

Quando Jennifer Lopez ha partecipato ai Grammy Awards nel 2000, il suo audace abito firmato Versace è diventato immediatamente una leggenda della moda, e anche la query di ricerca più popolare su Google in quel momento. A quei tempi, i risultati di ricerca non erano altro che un elenco di link blu, quindi gli utenti non riuscivano a trovare facilmente l’immagine che cercavano. Questo evento ci ha dato l’ispirazione per creare Google Immagini.

2001: "Forse cercavi"

"Forse cercavi", che suggerisce la grafia corretta di una parola, è stata una delle nostre prime applicazioni di machine learning. In precedenza, se la ricerca conteneva un errore di ortografia (ad es. "florescente"), aiutavamo l’utente a trovare altre pagine che contenessero lo stesso errore, ma generalmente non sono le pagine migliori che trattano l’argomento in questione. Nel corso degli anni abbiamo sviluppato nuove tecniche basate sull’IA per garantire che, anche in caso di errori di battitura, l’utente possa trovare ciò che cerca.

2002: Google News

Durante i tragici eventi dell’11 settembre 2001, le persone hanno avuto difficoltà a trovare informazioni tempestive nella Ricerca. Per soddisfare l’esigenza di avere notizie in tempo reale, l’anno successivo abbiamo lanciato Google News, che fornisce link a svariate fonti per una determinata notizia.

2003: Easter Egg

Nel corso degli anni, i Googler hanno sviluppato numerosi easter egg ingegnosi che hanno nascosto all’interno della Ricerca. Nel 2003, uno dei nostri primi easter egg ha dato la risposta alla domanda fondamentale sulla vita, l'universo e tutto quanto e, da allora, milioni di persone hanno girato le loro pagine di traverso, hanno eseguito un mulinello, sono entrati in un divertente loop ripetitivo e hanno celebrato momenti della cultura popolare.

2004: completamento automatico

Non sarebbe fantastico digitare alla stessa velocità del pensiero? La soluzione è il completamento automatico, una funzionalità chiamata in un primo momento "Google Suggest" che prevede automaticamente le query e le mostra nella barra di ricerca mentre si digita. Oggi, il completamento automatico riduce il tempo di digitazione in media del 25% e si stima che faccia risparmiare oltre 200 anni di tempo di digitazione al giorno.

2004: informazioni locali

In passato, le persone si affidavano agli elenchi telefonici tradizionali per trovare informazioni sulle attività commerciali. Il web ha aperto la strada alla ricerca locale, come "pizza a Milano" o "parrucchieria 90100". Nel 2004, Google Local ha aggiunto alle schede delle attività commerciali informazioni pertinenti, come mappe, indicazioni stradali e recensioni. Nel 2011, abbiamo aggiunto il click-to-call sui dispositivi mobili, rendendo più semplice contattare le attività ovunque ci si trovi. In media, i risultati di ricerca locale nella Ricerca generano oltre 6,5 miliardi di interazioni con le attività, inclusi ordini di cibo, telefonate, indicazioni stradali e prenotazioni.

2006: Google Traduttore

I ricercatori di Google hanno iniziato a sviluppare la tecnologia di traduzione automatica nel 2002 per contrastare le barriere linguistiche online. Quattro anni più tardi, abbiamo lanciato Google Traduttore per le traduzioni di testi dall’arabo all’inglese, e viceversa. Oggi Google Traduttore supporta più di 100 lingue, di cui 24 aggiunte lo scorso anno.

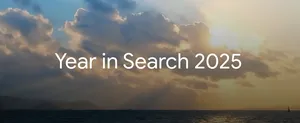

2006: Google Trends

Google Trends è stato ideato per aiutarci a comprendere le tendenze sulla Ricerca con dati aggregati (e creare la nostra campagna annuale Un anno di ricerche). Oggi Google Trends è il più grande set di dati gratuiti al mondo nel suo genere e permette a giornalisti, ricercatori, studenti e brand di scoprire come sono cambiate le ricerche nel corso del tempo.

2007: Universal Search

Risultati di ricerca utili dovrebbero includere informazioni pertinenti in tutti i formati, come link, immagini e video. Per questo motivo abbiamo riprogettato i nostri sistemi per effettuare ricerche tra tutti i tipi di contenuti contemporaneamente, decidere quando e dove incorporare i risultati e fornire i risultati in modo chiaro e intuitivo. Questa riprogettazione ha dato luogo a Universal Search, la modifica più radicale apportata fino ad allora alla Ricerca.

2008: app mobile Google

Con l’arrivo dell’App Store di Apple, abbiamo lanciato la nostra prima app mobile Google su iPhone. Funzionalità quali il completamento automatico e "La mia posizione" hanno semplificato la ricerca riducendo il numero di tasti premuti e sono state particolarmente utili sugli schermi più piccoli. Oggi, con l'app di Google - disponibile sia su Android che su iOS - si possono fare molte cose, dall'aiuto per i compiti di matematica con Lens all'accesso a strumenti di traduzione visiva con un solo tocco.

2008: ricerca vocale

Nel 2008 abbiamo introdotto la possibilità di effettuare ricerche tramite la voce sull’app mobile Google e nel 2011 abbiamo esteso questa funzione anche sui computer. Con la ricerca vocale, le persone possono effettuare ricerche con la voce toccando semplicemente un pulsante. Oggi la ricerca vocale è particolarmente diffusa in India, dove la percentuale di indiani che effettuano quotidianamente query vocali è quasi il doppio della media globale.

2009: linee dirette per le emergenze

A seguito di un suggerimento di una madre che ha avuto difficoltà a trovare informazioni su antiveleno dopo che la figlia ha ingerito qualcosa di potenzialmente pericoloso, abbiamo creato una casella per la linea diretta antiveleno nella parte superiore della pagina dei risultati di ricerca. Dal lancio abbiamo incrementato le linee dirette per le emergenze per i momenti critici, come la prevenzione dei suicidi.

2011: Ricerca tramite immagine

A volte può essere difficile descrivere a parole ciò che si vuole cercare. Per questo motivo abbiamo lanciato Ricerca tramite immagine: potete caricare qualsiasi immagine o URL immagine, scoprire di cosa si tratta e dove si trova questa immagine altrove nel web. Questo aggiornamento ha aperto la strada a Lens.

2012: Knowledge Graph

Abbiamo introdotto il Knowledge Graph, una vasta raccolta di persone, luoghi e oggetti nel mondo e il modo in cui sono correlati, per rendere più semplice trovare risposte rapide. Le schede informative, la prima funzionalità basata sul Knowledge Graph, offrono una rapida istantanea delle informazioni su argomenti quali celebrità, città e squadre sportive.

2015: orari di punta

Abbiamo lanciato la funzionalità degli orari di punta sulla Ricerca e su Maps per aiutare le persone a scoprire quali sono gli orari più affollati del giorno quando cercano luoghi come ristoranti, negozi e musei.

2016: Discover

Con il lancio di un feed personalizzato (adesso chiamato Discover), abbiamo aiutato le persone a esplorare contenuti personalizzati in base ai loro interessi direttamente nell’app di Google, senza dover effettuare ricerche.

2017: Lens

Google Lens trasforma la fotocamera in una query di ricerca analizzando gli oggetti presenti in un’immagine, confrontandoli con altre immagini e classificando queste altre immagini in base alla somiglianza e alla pertinenza con l’immagine originale. Oggi Lens elabora oltre 12 miliardi di ricerche visive al mese.

2018: Previsione di inondazioni

Per aiutare le persone a prepararsi meglio a inondazioni imminenti, grazie all’IA abbiamo creato modelli di previsione che prevedono quando e dove si verificheranno inondazioni devastanti. I nostri sforzi si sono concentrati dapprima in India e oggi abbiamo esteso gli allarmi inondazioni a 80 paesi.

2019: BERT

Buona parte di ciò che rende utile la Ricerca è la nostra capacità di comprendere il linguaggio. Nel 2018 abbiamo introdotto e reso open source una tecnica basata sulle reti neurali per addestrare i nostri modelli di comprensione del linguaggio: BERT (Bidirectional Encoder Representations from Transformers). BERT rende la Ricerca più utile perché comprende meglio il linguaggio considerando il contesto completo di una parola. Dopo test rigorosi nel 2019, abbiamo applicato BERT a oltre 70 lingue.

2020: Shopping Graph

Lo shopping online è diventato molto più semplice e completo da quando abbiamo offerto gratuitamente a tutti i retailer o brand la possibilità di mostrare i propri prodotti su Google. Abbiamo inoltre introdotto Shopping Graph, un set di dati basato sull’IA di prodotti, venditori, brand, recensioni e inventari locali in continuo aggiornamento, che oggi conta 35 miliardi di schede di prodotto.

2020: Canta e cerca

Abbiamo lanciato Canta e cerca nell’app di Google, così non sarete più demoralizzati quando non ricordate il nome di una canzone che avete in testa. La funzionalità di machine learning identifica il potenziale brano che corrisponde a ciò che fischiettate, canticchiate o di cui cantate la melodia. È poi possibile esplorare informazioni sul brano e sull’artista.

2021: Informazioni su questo risultato

Per aiutare le persone a prendere decisioni più informate su quali risultati saranno più utili e affidabili per loro, abbiamo aggiunto "Informazioni su questo risultato" accanto alla maggior parte dei risultati di ricerca. Spiega perché viene mostrato un risultato e offre maggiore contesto in merito ai contenuti e alla fonte, in base alle best practice fornite da esperti dell’informazione. Informazioni su questo risultato è adesso disponibile in tutte le lingue in cui è disponibile la Ricerca.

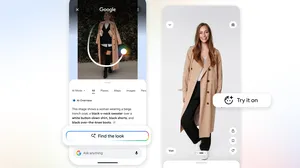

2022: Ricerca Multipla

Per aiutarvi a scoprire le informazioni che state cercando, indipendentemente da quanto siano complesse, abbiamo creato un modo completamente nuovo per effettuare ricerche contemporaneamente tramite testo e immagini attraverso la ricerca multipla. Adesso potete scattare una foto del vostro tavolo da pranzo e aggiungere la query “tavolino da tè” per trovare un tavolo abbinato. La ricerca multipla, che abbiamo lanciato in un primo momento negli Stati Uniti, è adesso disponibile a livello globale sui dispositivi mobili, in tutte le lingue e in tutti i paesi in cui è disponibile Lens.

2023: Search Labs ed esperienza generativa nella Ricerca (SGE)

Ogni anno, nella Ricerca svolgiamo centinaia di migliaia di esperimenti per scoprire come rendere Google più utile. Con Search Labs potete testare esperimenti in fase iniziale e condividere il vostro feedback direttamente con i team che ci lavorano. Il primo esperimento, la SGE, porta il potere dell’IA generativa direttamente nella Ricerca. Potete cogliere il senso di un argomento grazie a panoramiche basate sull’IA, suggerimenti per esplorare altri contenuti e modi naturali di chiedere approfondimenti. Dal lancio negli Stati Uniti, abbiamo rapidamente aggiunto nuove funzionalità, e tante altre verranno aggiunte in futuro.

Poiché seguo il mondo dei motori di ricerca da più di vent’anni, ho davvero apprezzato questo viaggio nel passato che mi ha portato a riflettere sul punto da cui è partita Google e su quanto è andata lontana.