I/O 2022: Busque sobre o mundo, de qualquer forma e em qualquer lugar

As pessoas se informam de vários jeitos diferentes: conversando entre si, observando o mundo ao redor – e, é claro, pesquisando na internet. Embora digitar palavras numa caixa de busca tenha se tornado instintivo para tanta gente, essa não é nem de longe a forma mais natural de expressar o que estamos procurando. Um exemplo: se estou andando pela rua e vejo uma árvore interessante, talvez eu aponte para a árvore e pergunte a um amigo qual é a espécie, ou se ele sabe onde encontro um viveiro para comprar mudas. Há alguns anos, se eu fosse fazer essas mesmas perguntas a um mecanismo de busca… Bom, teria sido necessário fazer muitas perguntas.

O Google trabalha de forma incansável para deixar essa experiência cada vez melhor. Já estamos na jornada para que a busca seja mais e mais natural. A pessoa pode estar assobiando uma melodia que não sai da cabeça ou usando o Google Lens para fazer pesquisas visuais (o que, hoje em dia, ocorre mais de oito bilhões de vezes por mês). Não importa: atualmente, existem mais formas de pesquisar e explorar o mundo do quem em qualquer momento da história.

Hoje estamos redefinindo, mais uma vez, a Busca do Google. Aliamos nossa compreensão de todos os tipos de informação – texto, voz, visual, etc. – para que as pessoas consigam encontrar informações úteis sobre qualquer coisa que vejam, escutem ou vivam, da maneira mais intuitiva para cada um. Enxergamos um futuro que permita pesquisar o mundo, de qualquer forma e em qualquer lugar.

Encontre informações locais com multisearch

O recente lançamento do multisearch – uma das principais atualizações à Busca em muitos anos – é um importante marco nesse percurso. No aplicativo do Google, é possível pesquisar com imagens e texto ao mesmo tempo, como descrito no exemplo de apontar para um objeto e fazer uma pergunta para um amigo.

Agora, estamos acrescentando uma maneira de encontrar informações locais com o multisearch. Assim, o usuário conseguirá achar o que procura em meio aos milhões de pequenas empresas locais que estão no Google. Será possível usar uma fotografia, ou uma foto de tela, e acrescentar a opção “perto de mim”. Com isso, a pessoa verá opções de restaurantes ou lojas próximas que tenham a roupa, o eletrodoméstico ou o prato que está procurando.

Ainda este ano será possível encontrar informações locais usando o recurso multisearch.

Digamos que você veja na internet um prato bem colorido e fique com vontade de experimentar, mas não saiba o nome ou os ingredientes daquela comida. Ao usar o multisearch para encontrar o prato nas suas proximidades, o Google faz uma varredura em milhões de imagens e avaliações publicadas na internet, ou vindas da comunidade que contribui com o Maps. Assim, encontramos resultados de lugares próximos que oferecem aquela comida – e, ao usuário, basta sair para curtir.

O recurso de informações locais no multisearch estará disponível ainda este ano em inglês, e ao longo do tempo será ampliado para mais idiomas.

Explorar cenas: um jeito de ver o contexto mais amplo

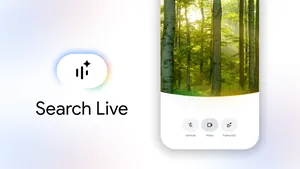

Hoje em dia, quem faz buscas visuais no Google reconhece objetos registrados num único quadro (ou “frame”, em inglês). Às vezes, porém, a pessoa pode estar atrás de informações sobre a cena e o contexto como um todo.

No futuro, graças a um avanço chamado “explorar cenas”, será possível usar o multisearch para movimentar a câmera e obter informações imediatas sobre diversos objetos numa cena.

No futuro, o recurso “explorar cenas” vai ajudar a descobrir informações sobre diversos objetos numa cena, ao mesmo tempo.

Imagine que você está tentando escolher o chocolate perfeito para uma amiga que entende do assunto. Você sabe que a pessoa adora chocolate amargo, mas não gosta de nozes, e quer escolher um produto de boa qualidade. Com o recurso “explorar cena”, será possível escanear toda a prateleira com a câmera do celular e obter informações úteis sobre os produtos à sua frente. Essa novidade é um importante avanço na capacidade dos aparelhos entenderem o mundo da mesma forma que as pessoas fazem, para que seja fácil encontrar o que o usuário procura. Estamos animados para trazer esse recurso ao multisearch no futuro.

Essas são as medidas mais recentes que adotamos para ajudar as pessoas a fazer buscas de qualquer forma e em qualquer lugar. Mas estamos fazendo mais, e indo além da Busca. Avanços em inteligência artificial (IA) estão deixando os mundos físico e virtual ainda mais próximos no Google Maps, e permitindo interagir com o Google Assistente de maneiras ainda mais naturais e intuitivas. Para garantir que as informações sejam realmente úteis para pessoas das mais diferentes comunidades, também é fundamental que todos os usuários e usuárias se vejam representados nos resultados exibidos. Todo esse trabalho é guiado pelo nosso compromisso de ajudar as pessoas a fazer pesquisas em segurança, com acesso a novos jeitos de controlar a presença e as informações pessoais de cada um na internet.